ChatGPT fasziniert. Es scheint so, als sei der Traum der Künstlichen Intelligenz wahr geworden. Doch ist das wirklich so? In dieser Folge unserer Serie „Wohin geht es in Digitalien?“ zeigen wir, wo die Technik wirklich steht und warum wir keine Angst vor der Entwicklung zu haben brauchen.

Wer sich für Technik interessiert, kommt an dem Hype kaum vorbei: Seit Ende 2022 ist der ChatBot ChatGPT (Chat Generative Pretrained Transformer) online und hat seitdem das Interesse am Megatrend Künstliche Intelligenz (KI) in nie geahnte Dimensionen geschossen. Das Besondere – und für viele Faszinierende – an dieser Anwendung liegt darin, dass sie mit den Nutzern in natürlicher Sprache kommuniziert und so schnell vergessen lässt, dass der Gesprächspartner eine Maschine ist.

Aufmacherbild: JuliusH via Pixabay

ChatGPT basiert auf 45 Terabyte Daten

Möglich macht dies das sogenannte Large Language Model, auf das ChatGPT zurückgreift. Dieses Sprachmodell wurde mit Rohdaten im Umfang von 45 Terabyte gefüttert (45000 Gigabytes) und umfasst die gewaltige Menge von 175 Milliarden Parametern: Zusammenhänge, Querverweise, Bewertungen, Klassifizierungen von Wörtern, Satzteile, Sätze und mehr.

Technische Grundlage ist die Transformer-Architektur, die Google im Jahr 2017 vorgestellt hat. Damit wurde es erstmals möglich, dass Algorithmen die Zusammenhänge zwischen Wörtern, ihrer Stellung im Satz und ganzen Satzbestandteilen erkennen. Die sogenannte „Self Attention“ erlaubte zusätzlich, ihre Wichtigkeit zu bewerten: Die Algorithmen können aus richtigen Antworten lernen und verbessern so ihr Antwortverhalten. Im Fall von ChatGPT sind aber auch menschliche Bewertungen eingeflossen, was gegenüber anderen Systemen wie etwa dem Open-Source Projekt Bloom oder das von der Facebook-Mutter Meta vorgestellte OPT zu wesentlich besseren Ergebnissen geführt hat.

Können KIs den Menschen überflügeln?

Es stellt sich die Frage: Kann ein solches System den Menschen überflügeln? Bereits seit den fünfziger Jahren des letzten Jahrtausends gibt es die Idee, Computern menschliches Denken und Lernen beizubringen, um damit komplexe Problem zu lösen. Die Science-Fiction-Kultur ist voll von Beispielen künstlicher Intelligenz. Eines der berühmtesten ist wohl HAL9000, der Supercomputer an Bord der Discovery One. Regisseur Stanley Kubrik schickt das Raumschiff 1968 im Film „2001 – Odyssee im Weltraum“ auf eine Jupiter-Mission mit psychedelischem Ende. Unterwegs wird HAL zur übermenschlichen Gefahr – er wendet sich gegen seine vermeintlich unvollkommenen menschlichen Begleiter. Dieses Szenario – die künstliche Intelligenz als Feind der Menschen – prägte lange das Bild von Computerintelligenz mit. Die Wahrheit sieht jedoch ganz anders aus. Zumindest auf absehbare Zeit.

Sicher: In den letzten zehn Jahren hat sich die Rechenleistung von Computern exponentiell entwickelt – auch dank Cloud-Technik und vernetzte Rechenzentren. Und auch die für KI genutzten Algorithmen sind immer komplexer und mathematisch immer präziser geworden. Doch sie sind keineswegs perfekt. Letztlich ist das, was wir heute Künstliche Intelligenz nennen, immer noch auf bestimmte Anwendungsgebiete beschränkt – etwa in der Medizin. Und auch das derzeit so gehypte ChatGPT ist da eher nur ein evolutionärer Schritt.

ChatGPT hat nur beschränktes Wissen

Einer der größten Nachteile von ChatGPT liegt darin, dass der Großteil des Trainingsmaterials aus den Jahren 2021 und früher datiert. Das System hat zudem keine direkte Internet-Verbindung. Dies führt dazu, dass die Antworten, die der Chatbot gibt, nicht immer auf der Höhe der Zeit sind. Da sie ChatGPT aber formal überzeugend präsentiert, klingen diese durchaus einleuchtend und logisch. ChatGPT geht bei seinen Antworten auf das Anliegen seiner Nutzer ein und berücksichtigt auch deren Feedback. Das System ist ein Charmeur – aber bisweilen auch ein schamloser Lügner.

Logischerweise sieht auch ChatGPT selbst keine Gefahr, dass es Menschen überflüssig machen könnte. „Es ist unwahrscheinlich, dass Language Models wie ChatGPT in der Lage sein werden, menschliche Entscheidungen in den meisten Bereichen vollständig abzulösen. Obwohl sie in der Lage sind, große Mengen an Daten schnell zu analysieren und Aufgaben auszuführen, die für Menschen schwierig oder unmöglich sind, fehlen ihnen jedoch die kognitiven Fähigkeiten und die menschliche Erfahrung, die für viele Entscheidungen erforderlich sind“ sagt der Bot in einem „Interview“ mit dem Online-Dienst ideas-magazin.

Umgang mit ChatGPT will gelernt sein

Und doch fürchten sich Pessimisten vor der Entwicklung. Grafiker, Fotografen, Journalisten, Texter, Sekretäre oder Anwälte: Sie alle sorgen sich darum, dass KI-Systeme sie ihre Jobs kosten könnten. In den Schulen und Universitäten geht die Sorge um, das KI künftig die Erstellung von Hausaufgaben und Seminararbeiten übernehmen könnte – ohne, dass es die Lehrkräfte merken.

Auch Robert Lepenies, Präsident der Karlsruher Karlshochschule, teilt die Bedenken. In einem Interview gegenüber heise.de sagt er: „Es gibt Studien dazu, dass selbst Experten menschliche und künstliche Expertise nicht auseinanderhalten können…. Dass KIs wissenschaftliche Texte produzieren können, wird nicht auf Sozialwissenschaften und Geisteswissenschaften beschränkt bleiben. Schon bald werden weitere Wissenschaftsfelder und alle Formen von Bildung betroffen sein. Konkret bedeutet das, dass es schwierig wird, Seminararbeiten zu vergeben und zu bewerten.“

Eine Konsequenz: Mittlerweile stellte ChatGPT-Erfinder Open AI selbst ein Tool vor, das erkennen kann, ob ein Text von dem Chatbot oder einer ähnlichen Lösung verfasst wurde. Der kostenlos angebotene „Classifier“ berechnet die Wahrscheinlichkeit dafür. Je länger der Text, desto höher die Trefferquote. Kenner der Materie prognostizieren deshalb ein Katz- und Maus-Spiel zwischen KI-gestützter Inhaltserzeugung und -erkennung.

ChatGPT besteht Matura

Die Landesschulvertretung Niederösterreich hat die Probe aufs Exempel gemacht und hat die letzte Zentralmatura (die dem deutschen Abitur entspricht) ChatGPT3 vorgelegt. Geprüft wurden die Fächer Deutsch, Mathematik, und Englisch. Die Arbeit des Bots im Fach Deutsch wurde einem menschlichen Prüfer vorgelegt, Mathematik und Englisch wurden anhand bekannter Lösungen bewertet. Das Ergebnis: bestanden! Für Deutsch gab es zwar nur eine 4 und für Mathe und Englisch eine 3 – aber immerhin. Allerdings: Für die Schulvertretung war nach eigener Aussage auch klar, dass das österreichische Schulsystem dem ChatBot in die Hände spielt. Es beruht sehr stark auf dem Auswendiglernen und Wissenswiedergabe, weniger auf logischer Wissensanwendung. Mangelnde Kreativität, wie sie KI-Systeme typischerweise zeigen, fällt da weniger in Gewicht.

Auch in Deutschland, genauer in Rheinland-Pfalz, beobachtet man die Entwicklung mit Sorge. Viele Lehrer wünschen sich dort Empfehlungen, wie sie mit der neuen Technik umgehen sollen. „Aktuell liegt die Last, dieses Themenfeld gewinnbringend in den schulischen Alltag zu integrieren, bei den einzelnen Lehrkräften, die sich selbstständig in die Materie einarbeiten“, stellt Matthias Fehl vom Verband Bildung und Erziehung (VBE) fest. Dabei geht es den Pädagogen weniger um die Gefahr des Mogelns als um das kritische Bewusstsein der Schüler für die Inhalte. Die Landesvorsitzende des Philologenverbands, Cornelia Schwartz, fordert deshalb, dass den Schülern die Wichtigkeit von Quellenkritik im Umgang etwa mit ChatGPT deutlich bewusst gemacht werden soll.

ChatGPT4: Noch intelligenter, noch geschwätziger

Die Probleme der Pädagogen dürften noch weiter zunehmen, denn die Unterscheidung, ob ein Mensch oder ein Computersystem als Autor eines Textes agiert, wird immer schwieriger. Auch bei ChatGPT. Dort ist seit 14.März 2023 die Version 4 verfügbar – zumindest für Abonnenten des Dienstes. Und Version 4 ist ein weiterer Schritt auf der Evolutionsleiter. Neu ist unter anderem, dass das System jetzt auch Bilder als Eingaben akzeptiert. So kann man ChatGPT4 etwa ein Foto vom Kühlschrankinneren vorlegen und das System bitten, ein Rezept für die gezeigten Lebensmittel zu kreieren.

Insgesamt ist der das System wohl aber auch noch mehr zur Plaudertasche geworden: Die mögliche Länge von Texten ist auf 25.000 Zeichen angeschwollen. Laut ersten Berichten hat sich der Trend zum Flunkern nicht verbessert. Auch ChatGPT4 nimmt es mit der Wahrheit bisweilen nicht so genau. In einem Interview mit StrictlyVC vom Januar diesen Jahres hat denn auch Sam Altman, der CEO von OpenAI, die neue Version relativiert. Sie sei halt immer noch keine AGI – keine allgemeine künstliche Intelligenz.

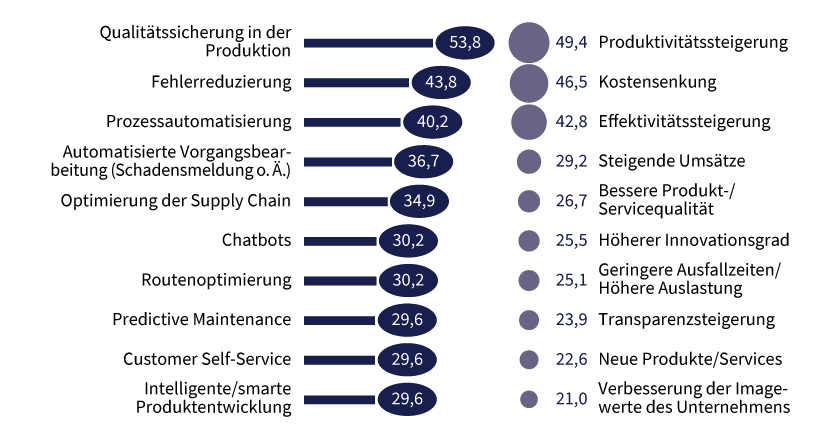

Auch diese Entwicklung wird aber wohl weiter voranschreiten. Dafür sorgt auch die Industrie. Schon jetzt ist laut IDG bereits in 70 Prozent aller Unternehmen eine KI zumindest im Bereich maschinelles Lernen im Einsatz. Die Firmen versprechen sich von deren Einsatz vor allem Produktivitäts- und Effektivitätssteigerungen und damit einhergehend Kostensenkungen.

Viele KI-Anwendungen zum Ausprobieren

Wer sich von dieser Entwicklung selbst ein Bild machen möchte, findet im Netz neben ChatGPT viele weitere Projekte, die sich auch kostenlos ausprobieren lassen. Wie etwa Neuroflash, das ebenfalls auf ChatGPT basiert. Neuroflash ist ein Autorenwerkzeug, das über 80 Disziplinen beherrscht: Es kann aufgrund einiger Stichwörter einen Werbetext schreiben, sich Schlagzeilen ausdenken, längere Texte zusammenfassen oder auch komplizierte Texte vereinfachen. Die Browsererweiterung Glasp hingegen transkribiert YouTube-Videos und fasst sie – ebenfalls mit Hilfe ChatGPT – schriftlich zusammen.

Neben den Chatbots und Textgeneratoren sind auch vor allem auch KI-basierte Bildgeneratoren schwer im Kommen. DALL-E2, ebenfalls von OpenAI, etwa generiert aus Sprachanweisungen Bilder– ein Albtraum für alle Stock-Foto-Anbieter.

Ein ähnliche Funktion bietet Midjourney. Midjourney erlebt derzeit einen ziemlichen Hype, obwohl es in seiner Bedienung eher kompliziert ist. Es erhält seine Anweisungen nur über einen Chatbot auf Discord.

KI: Das neue große Ding auch bei Microsoft

Bei den großen IT-Firmen dieser Welt ist bereits ein großes Wettrennen um KI-Anwendungen ausgebrochen. Microsoft, das sich in drei Finanzierungsrunden in Summe mit rund 13 Mrd. US-Dollar bei OpenAI beteiligt hat und nun rund 49 Prozent hält, hat ChatGPT in seine Suchmaschine Bing eingebaut. Wer mag, kann das System nach einer schnellen Freischaltung ausprobieren. Schon bald soll der ChatBot in Form des Microsoft 365 Copilot auch in die Office-Programme einziehen und etwa helfen, Texte zu kürzen oder aber Meetings, die über Teams gelaufen sind, als Text zusammenfassen.

Auch Google will Kunden des Geschäftskundenpakets Workspace in Gmail oder Google Docs, Google Sheets und Slides neue, KI-gestützte Features zur Verfügung stellen. Sie sollen dann etwa aus Daten, die aus E-Mails stammen, Präsentationen erstellen können. Die passenden Bilder soll sich die KI (basierend auf dem hauseigenen Pathway Language Model, PaLM) gleich selbst zusammensuchen.

Was heißt die Entwicklung für Medien und Öffentlichkeitsarbeit?

Gerade für den Einsatz KI-generierter Inhalte in Medien oder etwa in der Werbung ergeben sich viele, zum Teil erst nach intensiverer Beschäftigung mit der Materie auftauchende Fragestellungen. So tendieren die meisten Juristen zu der Einschätzung, dass für Inhalte, die nicht von einem Menschen erzeugt wurden, auch kein Urheberrecht gelten kann. Konsequenz: KI-generierte Texte und Bilder lassen sich nicht schützen – jeder kann sie verwenden, etwa auch als Basis eigener Weiterbearbeitungen. Für Unternehmen, die sich in ihrer Außendarstellung von ihren Mitbewerbern unterscheiden wollen – und gar keine Lust darauf haben, dass mögliche Gegner ihre Werbedarstellungen „kapern“ – , ein klares Hindernis.

Denkbar wäre deshalb, dass für solche Aufgabenstellungen doch weiterhin menschliche Texter, Grafiker, Fotografen etc. eingesetzt werden. Doch was passiert, wenn die ihrerseits der Arbeitserleichterung durch KI-Tools nicht widerstehen können – und dies eventuell erst später, mit verbesserten Tools „auffliegt“? „Garantiert nicht mit KI-Unterstützung erstellt“ könnte nicht nur zum Qualitätskriterium, sondern auch zum Vertragsbestandteil werden.

Ein weiteres großes Problemfeld: Was bedeutet die Entwicklung im Hinblick auf die Authentizität von Bildern? KI-generierte Fotos von einer angeblichen Festnahme des ehemaligen US-Präsidenten Donald Trump illustrieren das Problem: Denn diese Festnahme war zumindest zu diesem Zeitpunkt überhaupt nicht erfolgt. Was bedeutet es für die Glaubwürdigkeit von Medien, wenn sich Fake-Inhalte mit wenigen Mausklicks schneller erzeugen lassen denn je? Schon diskutieren Medienschaffende darüber, ob KI-Tools schon aus den skizzierten Gründen verboten oder ihre Ergebnisse zumindest gekennzeichnet werden müssen.

Content-Fast-Food versus Manufaktur-Inhalte

In der Kreativbranche zeichnet sich eine Zweiteilung ab: Wo es auf diese Aspekte nicht ankommt, dürften KI-generierte Inhalte sich wohl schnell verbreiten. Wo Auftraggeber höhere Ansprüche haben, dürfte menschlich gemachte Inhalte (sozusagen „Manufaktur-Content“) zum Qualitätsmerkmal werden. Oft werden Analogien gezogen wie der Unterschied zwischen einem Fertig-Gericht aus der Tiefkühltruhe und ambitioniertem Kochen mit frischen Zutaten. Die Realität in vielen Restaurants unterstreicht aber auch die Grauzonen, die es zwischen solchen Ansprüchen gibt.

Ein weiteres Betätigungsfeld für Inhalts-Experten von Textern bis Fotografen dürfte darin entstehen, die Ergebnisse von KI-Systemen zu kontrollieren und wo nötig zu verbessern. Schon heute nutzen etwa viele Übersetzer Maschinenübersetzungen als Arbeitsbasis, schleifen dann aber von Hand die Fehler und Missverständnisse ab, die dem KI-System unterlaufen sind. Journalisten sollten, wenn sie KI-Tools denn einsetzen, viel Aufmerksamkeit auf das Fact Checking der Ergebnisse legen. Und auch KI-erzeugte Bilder brauchen gerne mal zusätzliche Nacharbeit, wenn einer Bilderzeugungs-KI á la DALL-E zum Beispiel die Hände einer Person nicht wirklich überzeugend gelungen sind.

Nicht zu unterschätzen ist jedoch wiederum der Nutzen von KI-Inhalten etwa in der Konzeptionsphase oder als Briefing-Grundlage. Art Directoren und andere Auftraggeber können Ergebnises per KI-Tool skizzieren. Und dann auf dieser Grundlage einer Menschen beauftragen, der das Ergebnis dann besser und individueller umsetzen soll.

Einig sind sich Beobachter der Entwicklung zu alledem vor allem in einem: Wie die Welt von Medien, Werbung, Schulen und Universitäten angesichts des Siegeszugs von KI in wenigen Jahren aussehen dürfte, ist heute schwerer einzuschätzen denn je.